Entender cómo funciona un modelo de lenguaje nos permite ir más allá del asombro y usarlos con criterio, intención y propósito. Porque la verdadera inteligencia no está solo en la tecnología, sino en cómo decidimos guiarla.

Cada vez que escribimos una pregunta a un asistente basado en inteligencia artificial generativa y obtenemos una respuesta clara, estructurada y aparentemente razonada, ocurre algo curioso: tendemos a atribuirle comprensión. Pero lo que está pasando por dentro es mucho más interesante, y más técnico, que esa idea simplificada de “la máquina piensa o razona” cuando solo reconoce patrones.

Un modelo de lenguaje grande, o LLM, funciona a partir de una tarea muy concreta: predecir el siguiente elemento de texto más probable dado un contexto previo. Ese elemento no siempre es una palabra completa; muchas veces es un token, que puede ser una sílaba, una parte de una palabra o incluso un signo de puntuación. Antes de “entender” un texto, el modelo lo descompone en estas piezas y trabaja matemáticamente con ellas.

Por ejemplo, si escribimos:

“La inteligencia artificial aplicada a la salud requiere datos de alta…”

El modelo no completa la frase porque “sepa” de salud, sino porque, al analizar millones de textos previos, ha aprendido que después de esa secuencia suelen aparecer tokens como calidad, resolución o confiabilidad. Internamente, lo que ocurre es una distribución de probabilidades: cada posible token recibe un valor, y el modelo selecciona uno según esa distribución. La sensación de coherencia emerge de esa estadística refinada, no de una comprensión conceptual.

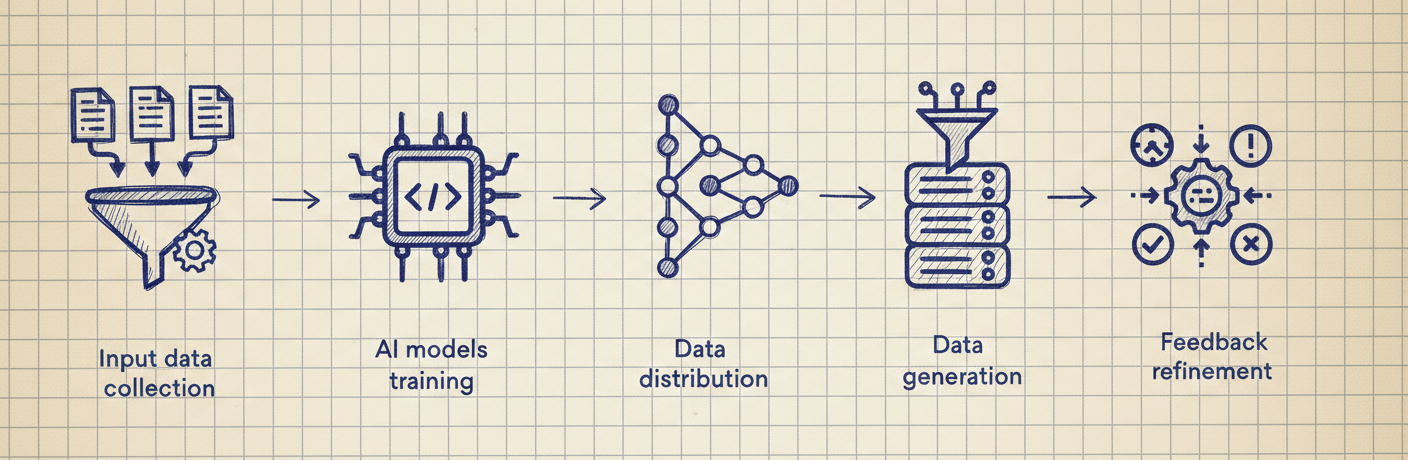

Ese refinamiento se logra durante el entrenamiento. En una primera fase, el modelo se expone a enormes volúmenes de texto y aprende a minimizar el error entre lo que predice y lo que realmente viene después. Técnicamente, esto se hace ajustando millones de parámetros mediante algoritmos de optimización. No hay etiquetas, no hay explicaciones humanas; solo un objetivo claro: reducir el error de predicción. En esta etapa, el modelo adquiere estructura lingüística, relaciones semánticas y patrones de uso del lenguaje.

Luego viene una segunda fase, más cercana a lo humano, donde el modelo se ajusta para seguir instrucciones, responder preguntas y mantener cierto tono o límites. Aquí entran ejemplos curados y retroalimentación humana. Es importante entender esta diferencia, porque explica por qué un LLM puede escribir con gran soltura sobre casi cualquier tema, pero aun así fallar en matices críticos si no se le guía bien.

El verdadero salto técnico de los LLM está en la arquitectura Transformer y, en particular, en el mecanismo de autoatención. A diferencia de modelos antiguos que leían el texto de forma secuencial, un Transformer analiza una frase completa y calcula qué partes del texto son más relevantes entre sí. Cada token “mira” a los demás y asigna pesos: algunos fragmentos importan más que otros para interpretar el significado.

Supongamos esta frase:

“Los datos longitudinales permiten modelar la evolución de la capacidad funcional en el envejecimiento.”

Cuando el modelo procesa la palabra evolución, presta más atención a datos longitudinales que a envejecimiento, porque estadísticamente esa relación es más fuerte para construir sentido. Este juego de pesos ocurre en múltiples capas, lo que permite captar relaciones simples y complejas al mismo tiempo. No es memoria en el sentido humano; es relevancia calculada en tiempo real.

Ahora bien, esta misma lógica explica uno de los fenómenos que más desconciertan a quienes usan estos modelos: su capacidad para equivocarse con elegancia. Un LLM no verifica hechos ni contrasta fuentes por sí mismo. Su función objetivo no es la verdad, sino la coherencia lingüística. Si una afirmación es probable dentro del patrón aprendido, puede aparecer como respuesta aunque sea incorrecta. Por eso es capaz de inventar referencias, fechas o autores sin “darse cuenta”. No está mintiendo; está completando una secuencia de texto plausible.

Aquí es donde el uso consciente marca la diferencia. Un LLM es extraordinariamente útil para explorar ideas, generar borradores, explicar conceptos técnicos en lenguaje sencillo o simular escenarios. En investigación, puede ayudar a pensar estructuras, identificar relaciones o incluso detectar inconsistencias narrativas. Pero no sustituye el juicio experto ni la validación rigurosa. Funciona mejor cuando lo usamos como amplificador del pensamiento, no como su reemplazo.

Entender cómo funciona un LLM cambia la forma en que interactuamos con él. Nos obliga a formular mejores preguntas, a dar más contexto y a evaluar críticamente las respuestas. La inteligencia no está solo en el modelo; emerge de la interacción entre el sistema y la persona que lo guía.

Y quizá esa sea la idea central: la IA no nos ahorra pensar, nos invita a pensar mejor. La tecnología, por sí sola, no define el rumbo. El verdadero impacto aparece cuando combinamos capacidad técnica con intención, criterio y propósito.